W tym tekście spokojnie rozkładam na czynniki pierwsze, co dokładnie psuje kubity, jakie typy błędów pojawiają się w obliczeniach i czemu korekcja błędów jest tak dużym tematem w quantum computing. Bez matematyki i bez hype’u — za to z dobrymi intuicjami.

Co to w ogóle znaczy, że komputer kwantowy „popełnia błąd”?

Błąd w obliczeniach kwantowych to sytuacja, w której stan kubitu zmienia się inaczej, niż przewidywał program. Czasem to drobne odchylenie, czasem całkowite „rozsypanie się” obliczenia. Ponieważ wynik obliczeń kwantowych i tak bywa probabilistyczny, problemem nie jest sam fakt losowości, tylko to, że szum i zakłócenia wypychają rozkład wyników w złą stronę.

Warto też pamiętać o jednym: w komputerach klasycznych błędy zdarzają się rzadko na poziomie pojedynczych bramek logicznych. W komputerach kwantowych błędy są częścią codzienności, a cała sztuka polega na tym, by je ograniczać, kompensować i w dłuższej perspektywie — korygować.

Dlaczego kubity są tak delikatne?

Kubit działa wtedy, gdy jego stan jest bardzo dobrze odizolowany od otoczenia, a jednocześnie kontrolowany z ogromną precyzją. To brzmi jak sprzeczność — i trochę nią jest. Żeby wykonać obliczenie, musisz „dotknąć” kubitu sygnałami sterującymi. Ale każde niechciane „dotknięcie” z zewnątrz (ciepło, drgania, pola elektromagnetyczne, promieniowanie) też go zmienia.

Dobrym obrazem jest próbka dźwięku nagrywana w idealnie cichym studiu. Jeśli w tle pojawi się szum, nagranie nadal istnieje, ale traci jakość. Z kubitem jest podobnie, tylko że „jakość” potrafi spaść błyskawicznie.

Najczęstszy winowajca: dekoherencja, czyli „wyciek” informacji do świata

Dekoherencja to proces, w którym kubit traci swoje kwantowe właściwości, bo zaczyna niekontrolowanie oddziaływać z otoczeniem. Mówiąc po ludzku: środowisko „podsłuchuje” kubit. A kiedy stan jest podsłuchiwany, przestaje być idealnie kontrolowany i przewidywalny dla programu.

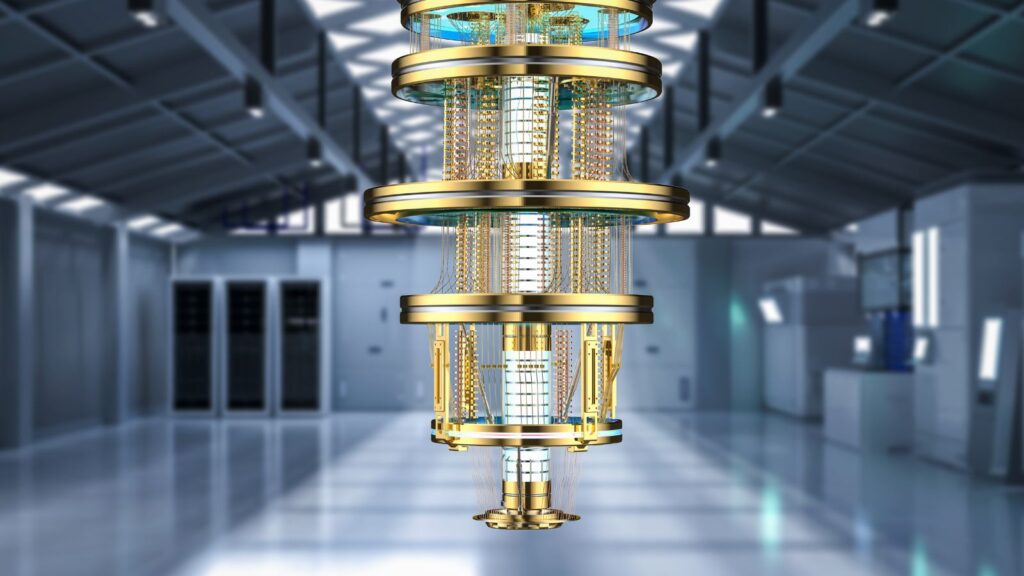

W praktyce dekoherencja ma różne źródła. Część jest banalna: minimalne ilości energii cieplnej, mikrodrgania, przypadkowe pola elektromagnetyczne. Część jest bardziej „inżynieryjna”: niedoskonałości materiałów, zanieczyszczenia, niestabilności w elektronice sterującej.

To dlatego wiele platform sprzętowych trzyma kubity w ekstremalnie niskich temperaturach i w bardzo kontrolowanych warunkach. Nie dlatego, że to „fajne”, tylko dlatego, że inaczej szum przykrywa sygnał.

Błędy sterowania: kiedy „kręcisz gałką”, ale minimalnie za mocno

Komputer kwantowy wykonuje program przez sekwencję operacji (bramek) realizowanych impulsami sterującymi. Jeśli impuls jest odrobinę za długi, za krótki albo ma minimalnie zły kształt, kubit nie trafia w dokładnie ten stan, który był planowany. To nie musi być spektakularna awaria — częściej jest to drobne odchylenie, które kumuluje się w dłuższym obliczeniu.

W świecie klasycznym możesz mieć „margines” i nadal działa. W świecie kwantowym margines bywa mikroskopijny. Dlatego tak dużo pracy idzie w kalibrację, stabilizację i ciągłe dostrajanie maszyn. Co ważne: nawet jeśli dziś wszystko jest świetnie skalibrowane, jutro parametry mogą się minimalnie przesunąć (tzw. dryf). I znowu rośnie liczba błędów.

Zakłócenia między kubitami: crosstalk, czyli „sąsiad przeszkadza”

W teorii chcesz sterować jednym kubitem albo parą kubitów. W praktyce kubity żyją blisko siebie, są połączone fizycznie i elektromagnetycznie, a sygnały sterujące mogą „przeciekać” na sąsiadów. To zjawisko często nazywa się crosstalkiem.

Efekt bywa frustrujący: wykonujesz operację na jednym miejscu układu, a delikatnie rozstrajasz inne miejsce. Im większy procesor (więcej kubitów), tym trudniej utrzymać porządek. I to jest jedna z przyczyn, dla których skalowanie komputerów kwantowych nie polega wyłącznie na „dodaniu kolejnych kubitów”.

Błędy odczytu: czasem kubit działa, tylko my źle „słyszymy” wynik

Na końcu obliczenia trzeba zmierzyć kubity. Pomiar jest momentem, w którym kwantowa subtelność zamienia się w klasyczny wynik (np. 0 albo 1). I tutaj również pojawiają się błędy: aparatura odczytowa może pomylić sygnały, zaklasyfikować stan w złą stronę, albo być podatna na szum.

To ważna intuicja: część problemów w quantum computing nie wynika z tego, że „stan się zepsuł”, tylko z tego, że pomiar jest niedoskonały. Dlatego w praktycznych eksperymentach często stosuje się procedury poprawy jakości odczytu (np. kalibracje, statystyczne korekty), zanim jeszcze wejdzie w grę pełna korekcja błędów kwantowych.

„Wycieki” do niechcianych stanów: błąd, którego nie widać od razu

W wielu technologiach kubit nie jest idealnym „dwustanowym” obiektem. On ma więcej możliwych stanów fizycznych, tylko my umownie używamy dwóch jako 0 i 1. Czasem, pod wpływem impulsów lub szumu, system „ucieka” do stanu spoza tej pary. To bywa nazywane leakage.

Taki błąd jest podstępny, bo dalsze operacje mogą przestać działać sensownie, a standardowe metody wykrywania błędów nie zawsze od razu to pokazują. Inżynieria sterowania i projektowanie bramek często skupia się na tym, by minimalizować właśnie takie „ucieczki”.

Rzadkie, ale realne: promieniowanie i pojedyncze zdarzenia losowe

Są też źródła błędów, które brzmią jak ciekawostka, ale dla dużych systemów zaczynają mieć znaczenie: pojedyncze zdarzenia spowodowane promieniowaniem kosmicznym lub naturalną radioaktywnością materiałów. Taki „strzał” energii potrafi chwilowo zaburzyć działanie części układu i wywołać serię błędów.

To kolejny powód, dla którego mówi się o komputerach kwantowych jak o bardzo czułych instrumentach laboratoryjnych. W pewnym sensie nimi są.

Dlaczego błędy są dziś tak ważne? Bo ograniczają długość i sens obliczeń

W uproszczeniu: im dłuższy program (więcej operacji), tym większa szansa, że po drodze coś pójdzie nie tak. Jeśli pojedyncza operacja ma małe prawdopodobieństwo błędu, to po setkach lub tysiącach operacji te małe prawdopodobieństwa zaczynają się sumować w praktyczny problem.

Dlatego w wiadomościach o sprzęcie kwantowym często pojawiają się pojęcia typu „fidelity” (jakość operacji) czy „error rate” (częstość błędów). Dla orientacji: w najlepszych demonstracjach laboratoryjnych błędy pojedynczych operacji potrafią być bardzo niskie, ale operacje dwukubitowe i cały „ekosystem” (sterowanie, odczyt, stabilność w czasie) nadal są trudniejsze do dopracowania. A to właśnie operacje między kubitami są kluczowe dla większości ciekawych algorytmów.

Mitigacja vs korekcja błędów: dwa podejścia, dwa światy

W praktyce spotkasz dwa terminy, które łatwo pomylić, a oznaczają coś innego.

Mitigacja błędów (error mitigation)

Mitigacja to sprytne techniki, które próbują zmniejszyć wpływ błędów na wynik bez pełnej „naprawy” stanu kwantowego. To trochę jak odszumianie nagrania: nie cofasz czasu, ale poprawiasz użyteczność tego, co masz. Mitigacja jest szczególnie ważna dziś, gdy pracujemy na urządzeniach, które nie mają jeszcze pełnej korekcji błędów.

Korekcja błędów kwantowych (quantum error correction)

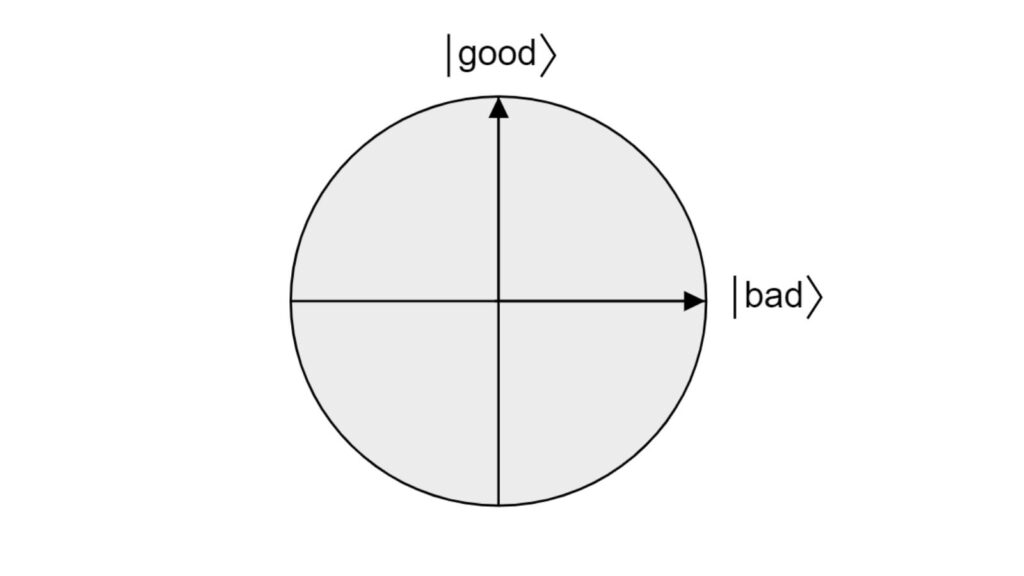

Korekcja błędów to podejście, w którym jedna „logiczna” informacja jest rozproszona na wiele kubitów fizycznych w taki sposób, by dało się wykrywać i naprawiać pewne typy zakłóceń. Kluczowa konsekwencja jest prosta: żeby komputer kwantowy był naprawdę odporny, potrzebuje dużo więcej kubitów, niż sugeruje liczba „kubity w specyfikacji”.

To właśnie tu rodzi się ogromna część dzisiejszego wyścigu: nie tylko zwiększać liczbę kubitów, ale robić to przy coraz niższych błędach i coraz lepszej stabilności, aż korekcja stanie się praktycznie opłacalna.

Jak czytać newsy o komputerach kwantowych bez wpadania w hype?

Jeśli chcesz realistycznie oceniać postęp, zamiast pytać „ile kubitów ma procesor?”, częściej warto pytać: jak stabilne są kubity w czasie, jak dobre są operacje dwukubitowe, jak wygląda odczyt, oraz czy zespół pokazuje wyniki na rosnącej skali (więcej kubitów i dłuższe obwody) bez dramatycznego wzrostu błędów.

To nudniejsze niż wielkie liczby w nagłówku, ale dużo bliższe prawdy. W kwantach jakość niemal zawsze wygrywa z samą ilością.

Najczęstsze pytania: błędy w kubitach

Czy błędy oznaczają, że komputery kwantowe „nie działają”?

Nie — oznaczają, że działają w trudnym reżimie, gdzie wynik trzeba traktować ostrożnie, a sprzęt wymaga stałej kalibracji i technik ograniczania szumu.

Czy da się całkowicie wyeliminować błędy?

W praktyce celem nie jest absolutne „zero błędów”, tylko taki poziom jakości i korekcji, by dało się wykonywać długie obliczenia z przewidywalnym rezultatem.

Dlaczego nie wystarczy po prostu powtórzyć obliczenia wiele razy?

Powtarzanie pomaga w części zadań, ale nie naprawia sytuacji, gdy szum systematycznie wypacza wynik albo gdy obliczenie jest zbyt długie i rozsypuje się za każdym razem.

Czy większa liczba kubitów zawsze oznacza więcej błędów?

Często rośnie trudność kontroli i ryzyko zakłóceń między elementami, ale dobrze zaprojektowana architektura może skalować się coraz lepiej. Sama liczba kubitów to tylko fragment historii.

Podsumowanie: błędy to nie wpadka, tylko główne pole walki

Kubity psuje wszystko, co sprawia, że przestają być idealnie odizolowane i precyzyjnie kontrolowane: kontakt z otoczeniem, niedoskonałe impulsy sterujące, przeszkadzające sąsiedztwo, trudny pomiar, a czasem nawet rzadkie zdarzenia losowe. To dlatego postęp w quantum computing często wygląda jak inżynieria „ciszy” — budowanie warunków, w których delikatny sygnał kwantowy ma szansę przetrwać wystarczająco długo.