W tym tekście wyjaśniam po ludzku, skąd biorą się błędy kwantowe, dlaczego są czymś innym niż „bug w programie” oraz jakie podejścia naprawdę pomagają je ograniczać — od inżynierii sprzętu, przez sterowanie impulsami, aż po korekcję błędów. Bez matematyki i bez obiecywania cudów.

Czym są „błędy kwantowe” i dlaczego to nie jest wstydliwy detal

Błąd kwantowy to sytuacja, w której stan kubitu lub wynik pomiaru odbiega od tego, co „powinno” wyjść w idealnym, czystym świecie. W praktyce oznacza to, że obliczenie jest zanieczyszczone szumem: część informacji znika, część się miesza, a część zostaje przekręcona.

To nie jest drobnostka. W klasycznym komputerze pojedynczy bit jest dość odporny: możesz go odczytać wiele razy, trzymać długo w pamięci i zwykle nie zmienia się sam z siebie. Kubit jest bardziej jak bardzo delikatna „pozycja wskazówki” na kompasie, którą łatwo trącić. Co ważne, samo sprawdzanie tej wskazówki (pomiar) zmienia sytuację — więc nie da się jej ciągle kontrolować bez kosztu.

Skąd biorą się błędy kwantowe? Najczęstsze źródła w praktyce

1) Dekoherecja: gdy kubit „przestaje grać” z resztą układu

Dekoherecja to utrata kwantowej „spójności” stanu. Brzmi abstrakcyjnie, ale intuicja jest prosta: kubit jest tak wrażliwy, że oddziałuje z otoczeniem (ciepło, drgania, promieniowanie, zakłócenia elektromagnetyczne) i stopniowo traci to, co w nim najcenniejsze — subtelną informację fazową potrzebną do interferencji.

W wielu dzisiejszych platformach czasy koherencji są rzędu mikrosekund do milisekund (zależnie od technologii i jakości urządzenia). To krótko. A w tym czasie trzeba wykonać serię operacji, zanim informacja zacznie „rozpływać się” w szumie.

2) Niedoskonałe bramki: gdy operacja jest prawie dobra, ale nie do końca

Operacje na kubitach (tzw. bramki) realizuje się impulsami sterującymi: mikrofalowymi, laserowymi albo innymi — zależnie od technologii. Te impulsy mają konkretny kształt, czas i energię. Jeśli minimalnie się pomylisz, efekt jest minimalnie inny. A „minimalnie” w kwantach szybko się kumuluje.

Typowe dzisiejsze błędy bramek dla najlepszych układów są często opisywane jako rzędu promili do setnych części (na poziomie 10-3–10-2, zależnie od bramki i sprzętu). To brzmi świetnie, dopóki nie uświadomisz sobie, że algorytmy potrzebują wielu bramek, a niektóre (szczególnie dwukubitowe) są trudniejsze i bardziej podatne na szum.

3) Crosstalk: gdy dotykasz jednego kubitu, a rusza się też sąsiad

W teorii kubity są osobnymi „pokrętłami”. W praktyce są gęsto upakowane na chipie lub w pułapce i mają wspólne elementy sterowania. Gdy wysyłasz impuls do jednego kubitu, część energii potrafi „przeciec” do innych. To zjawisko nazywa się crosstalk i jest jednym z powodów, dla których skalowanie do dużych układów jest takie trudne.

4) Błędy odczytu: gdy pomiar nie mówi całej prawdy

Na końcu obliczenia musisz zmierzyć kubity. I tu pojawia się prozaiczny problem: aparatura pomiarowa też ma swoje ograniczenia. Czasem odczyta „0”, choć było „1”, albo odwrotnie. Czasem wynik jest niepewny i trzeba go statystycznie uśredniać.

W praktyce dlatego wiele eksperymentów uruchamia ten sam obwód dziesiątki, setki albo tysiące razy. Nie po to, by „oszukać” fizykę, tylko po to, by oszacować rozkład wyników mimo szumu.

5) Dryf i kalibracja: urządzenie zmienia się w czasie

Komputer kwantowy to nie laptop, który działa podobnie rano i wieczorem. Parametry potrafią dryfować: minimalnie zmienia się częstotliwość, tło szumowe, efektywność impulsów. To oznacza, że system trzeba regularnie kalibrować, a wyniki z „wczoraj” nie zawsze przekładają się 1:1 na „dziś”.

Dlaczego nie da się po prostu „zrobić kopii” kubitu i naprawiać błędów jak w klasycznym świecie

W klasycznych systemach ratunkiem jest redundancja: kopiujesz bity, głosujesz większością, wykrywasz i poprawiasz błędy. W świecie kwantowym nie możesz dowolnie skopiować nieznanego stanu kubitu. Do tego pomiar niszczy część informacji, więc „sprawdzę co chwila, czy jest dobrze” odpada jako prosta strategia.

To nie znaczy, że korekcja błędów jest niemożliwa. Jest możliwa, ale wymaga sprytnego obejścia: kodowania informacji w wielu kubitach naraz i mierzenia nie samej informacji, tylko jej „sygnatur błędu” (tzw. syndromów). Wrócimy do tego za chwilę.

Jak ogranicza się błędy kwantowe już dziś: trzy warstwy podejścia

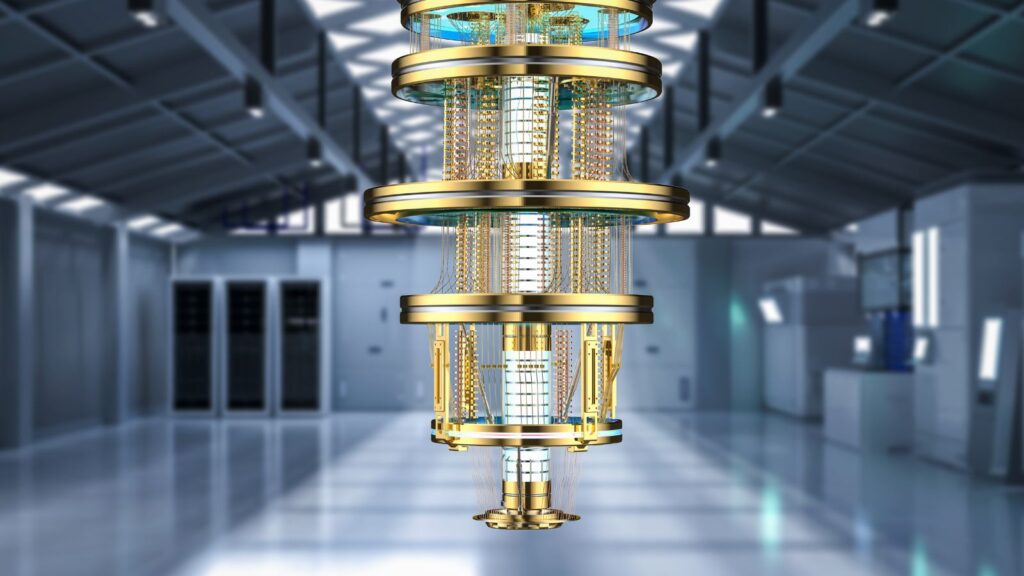

Warstwa 1: inżynieria sprzętu i środowiska

Najbardziej podstawowa walka z błędami dzieje się zanim uruchomisz jakikolwiek algorytm. Chodzi o to, by kubity miały „spokojne” warunki pracy i jak najmniej niechcianych interakcji z otoczeniem. Dlatego widzisz kriostaty, ekranowanie, kontrolę drgań i rozwój materiałów o mniejszych stratach.

To jest powód, dla którego postęp w quantum computing to nie tylko informatyka. To również bardzo twarda inżynieria: czystość procesu wytwarzania, stabilność elektroniki sterującej, lepsze rezonatory, mądrzejsze prowadzenie sygnałów. Każdy ułamek poprawy w sprzęcie przekłada się na realnie dłuższe obwody, które da się uruchomić sensownie.

Warstwa 2: sterowanie, kalibracja i „kształtowanie” impulsów

Nawet na tym samym sprzęcie można zrobić dużo, poprawiając to, jak sterujesz kubitami. W praktyce oznacza to dopracowywanie impulsów tak, by były mniej wrażliwe na zakłócenia, oraz ciągłą kalibrację, żeby bramki wykonywały się jak najbliżej ideału.

W tej warstwie często pojawiają się techniki, które brzmią jak drobna kosmetyka, ale robią różnicę: skracanie obwodów, wybieranie kolejności bramek tak, by mniej „męczyć” wrażliwe kubity, albo stosowanie sekwencji, które częściowo kasują wpływ wolnozmiennych zakłóceń (czasem nazywa się to dynamicznym odsprzęganiem).

Warstwa 3: redukcja błędów w oprogramowaniu (error mitigation)

Jest też podejście bardziej „software’owe”: zamiast udawać, że sprzęt jest idealny, próbujesz statystycznie skorygować wynik. To nie jest pełna korekcja błędów, bo nie przywraca stanu kubitów w trakcie obliczenia. Raczej pomaga wyciągnąć lepszą odpowiedź z zaszumionych pomiarów.

Przykładem są metody w rodzaju kalibracji błędów odczytu (gdy wiesz, jak często myli się pomiar, możesz częściowo odwrócić ten efekt w analizie) albo podejścia typu „zero-noise extrapolation”, gdzie uruchamiasz warianty obwodu o celowo różnym poziomie szumu i ekstrapolujesz wynik do hipotetycznego „zera”. To brzmi jak sztuczka — i trochę nią jest — ale bywa zaskakująco użyteczne w obecnej epoce urządzeń NISQ (czyli: głośnych, bez pełnej korekcji).

Korekcja błędów kwantowych (QEC): co to obiecuje i dlaczego jest takie trudne

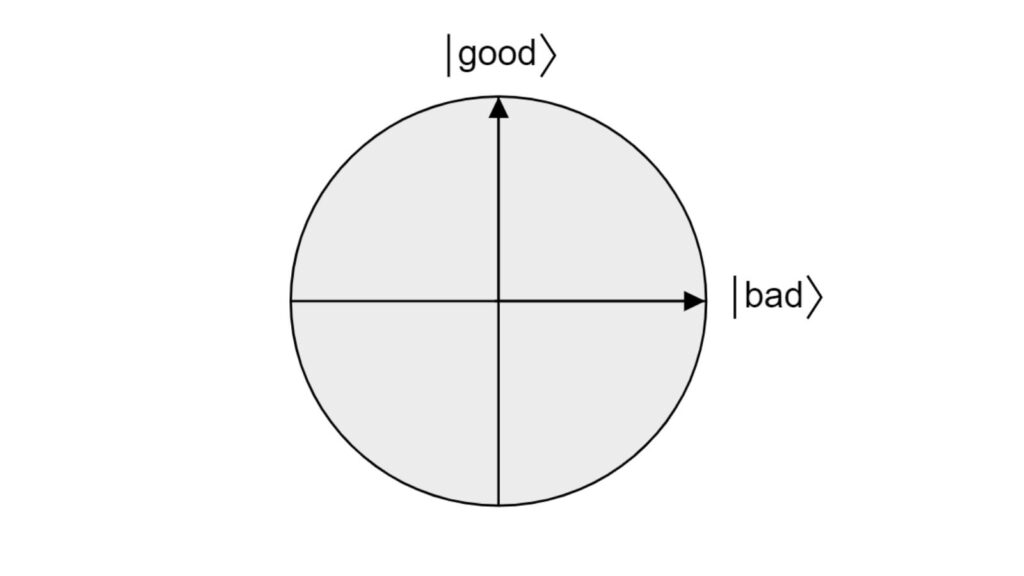

Gdy ktoś mówi o „prawdziwie skalowalnym komputerze kwantowym”, zwykle ma na myśli maszynę z korekcją błędów. Idea jest taka: zamiast przechowywać informację w jednym kubicie fizycznym, kodujesz ją w wielu kubitach, tworząc tzw. kubit logiczny. Potem regularnie mierzysz syndromy błędów i korygujesz je, nie poznając wprost przechowywanej informacji.

Brzmi jak magiczne obejście ograniczeń — i w pewnym sensie nim jest. Cena jest jednak wysoka. Żeby jeden kubit logiczny był naprawdę stabilny, potrzeba wielu kubitów fizycznych, a ich liczba rośnie, jeśli sprzęt ma większy szum. W popularnych rodzinach kodów (np. powierzchniowych) w praktyce mówi się często o setkach do tysięcy kubitów fizycznych na jeden bardzo dobry kubit logiczny, zależnie od docelowej niezawodności i jakości bramek.

To właśnie dlatego nagłówki o „komputerze z 1000 kubitów” nie mówią jeszcze, ile realnie da się na nim policzyć „bez bólu”. Liczy się nie tylko liczba kubitów, ale także ich jakość, architektura połączeń i to, czy system potrafi utrzymać korekcję błędów w stabilnym reżimie.

Jak czytać temat błędów jako użytkownik: proste pytania, które porządkują obraz

Jeśli jesteś ciekaw świata, ale nie chcesz wchodzić w techniczny gąszcz, możesz podejść do błędów kwantowych przez kilka bardzo praktycznych pytań.

Po pierwsze: czy dany wynik jest pojedynczą liczbą, czy rozkładem prawdopodobieństwa? W quantum computing często „wynikiem” jest rozkład, a nie jedno wskazanie, więc powtarzanie uruchomień nie jest oznaką porażki, tylko częścią metody.

Po drugie: ile operacji (bramek) i jakiego typu wymaga obwód? Im dłuższy obwód i im więcej operacji dwukubitowych, tym większe ryzyko, że szum zdominuje sygnał.

Po trzecie: czy ktoś mówi o mitigacji (poprawianiu wyniku po fakcie), czy o korekcji błędów (utrzymywaniu obliczenia „w ryzach” w trakcie)? To dwa różne poziomy dojrzałości.

I po czwarte: czy prezentowana przewaga jest odporna na realistyczne błędy, czy dotyczy bardzo specyficznego zadania w laboratoryjnych warunkach? To pytanie nie odbiera sensu badaniom. Po prostu pomaga trzymać proporcje.

Najczęstsze pytania o błędy kwantowe (FAQ)

Czy błędy kwantowe oznaczają, że komputer kwantowy „nie działa”?

Nie. Oznaczają, że działa w reżimie, w którym wynik ma niepewność i trzeba go interpretować statystycznie, a przy bardziej złożonych obwodach szum może zasłaniać sygnał.

Czy da się całkiem wyeliminować błędy kwantowe?

W praktyce nie da się ich wyzerować, ale da się je ograniczać i kontrolować. Długofalowym celem jest korekcja błędów, która pozwala wykonać bardzo długie obliczenia na kubitach logicznych.

Dlaczego trzeba powtarzać obliczenia tyle razy?

Ponieważ pomiar w quantum computing daje próbkę z rozkładu prawdopodobieństwa, a do tego dochodzą błędy odczytu i szum. Powtórzenia pozwalają oszacować, co jest sygnałem, a co przypadkiem.

Czy „więcej kubitów” zawsze znaczy „mniej błędów”?

Nie. Więcej kubitów pomaga dopiero wtedy, gdy potrafisz je dobrze kontrolować i ograniczać crosstalk, a docelowo użyć ich do korekcji błędów. Bez jakości i stabilności sama liczba niewiele gwarantuje.

Podsumowanie: błędy to dziś centrum historii o quantum computing

Najuczciwszy obraz dzisiejszych komputerów kwantowych jest taki: to bardzo precyzyjne, ale delikatne instrumenty. Błędy biorą się z otoczenia, niedoskonałego sterowania, trudności pomiaru i skomplikowanej dynamiki wielu kubitów naraz. Ogranicza się je równolegle na trzech frontach: sprzętowym, kontrolnym i programowym, a docelowym „game changerem” jest korekcja błędów na kubitach logicznych.