Zobacz, jak to działa: od tego, dlaczego pojedynczy kubit nie wystarcza, przez pomiary syndromu (czyli „objawów” błędu), aż po rolę klasycznego komputera, który w tle podejmuje decyzje naprawcze.

Dlaczego korekcja błędów jest w ogóle potrzebna?

Korekcja błędów jest potrzebna, bo kubity są delikatne i łatwo tracą „sens” tego, co miały przechowywać. W praktyce oznacza to, że otoczenie, niedoskonałe impulsy sterujące i szumy w układzie powodują drobne odchylenia, które z czasem rosną. W klasycznym komputerze też zdarzają się błędy, ale da się je relatywnie prosto wykrywać i poprawiać, bo bit jest albo 0, albo 1.

W świecie kwantowym nie ma tego komfortu. Stan kubitu nie jest po prostu „jedną wartością”, a bezpośredni odczyt potrafi zniszczyć to, co próbujesz obliczyć. Korekcja błędów musi więc działać sprytniej: nie „czyta” wyniku obliczeń, tylko monitoruje, czy system nie zaczyna zachowywać się podejrzanie.

Najważniejsza zmiana perspektywy: logiczny kubit to nie jeden kubit

W korekcji błędów kluczowe jest rozróżnienie: kubity fizyczne to te, które masz w laboratorium, a kubity logiczne to te, na których chcesz bezpiecznie liczyć. I tu pojawia się sedno: jeden kubit logiczny buduje się z wielu kubitów fizycznych.

To może brzmieć jak klasyczna „redundancja” (zrób kopie i po sprawie), ale w świecie kwantowym nie da się po prostu skopiować nieznanego stanu. Zamiast kopii stosuje się sprytne rozproszenie informacji po wielu kubitach tak, aby dało się wykryć zakłócenie, nie zaglądając do samej treści obliczeń.

Krok 1: „Rozsianie” informacji, czyli kodowanie stanu w wielu kubitach

Na start komputer kwantowy przygotowuje układ wielu kubitów fizycznych w taki sposób, żeby razem reprezentowały jeden kubit logiczny. Informacja jest „rozlana” po całej grupie: pojedynczy kubit fizyczny przestaje być nośnikiem całości, staje się tylko fragmentem większej całości.

Intuicyjnie możesz myśleć o tym jak o treści zapisanej nie w jednym zdaniu, ale w całym układzie zależności. Jeśli jeden element lekko się rozjedzie, to całość wciąż „pamięta”, jak powinna wyglądać spójna struktura — i można to wykorzystać do wykrycia problemu.

Krok 2: Wykrywanie „objawów” błędu bez podglądania danych

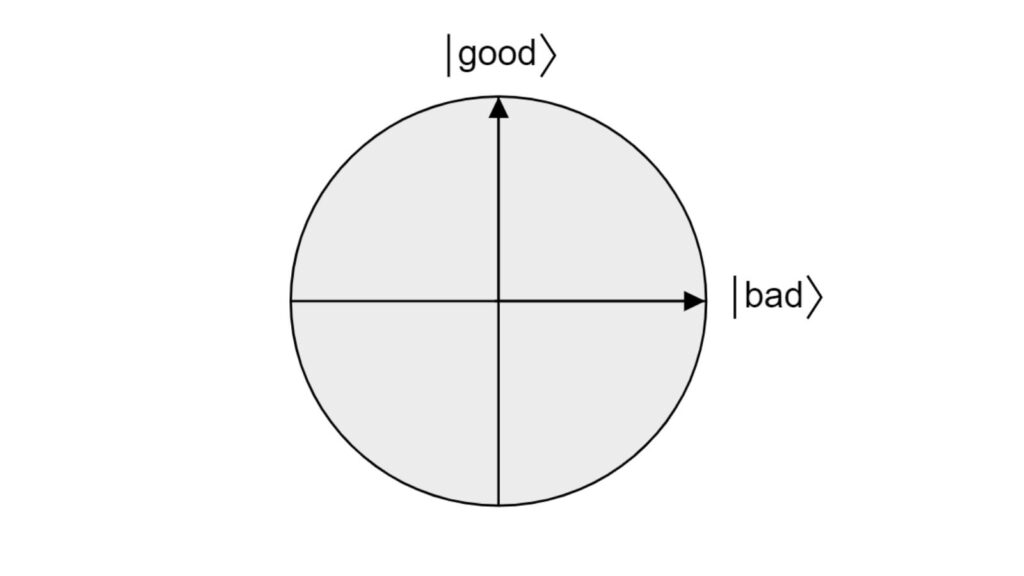

Korekcja błędów działa, bo potrafi odczytywać syndrom, czyli informację o tym, że coś poszło nie tak, ale nie co dokładnie było w środku. To jak z systemem alarmowym: nie musi znać treści rozmów w domu, żeby wykryć, że okno zostało otwarte.

W praktyce robi się to przez specjalne pomiary, które sprawdzają spójność układu. Te pomiary są zaprojektowane tak, by nie zdradzić wartości obliczeń (czyli nie „wycieka” wynik), ale by pokazać, czy w układzie pojawiły się oznaki zakłócenia.

Po co tu dodatkowe kubity?

Do pomiarów syndromu używa się zwykle dodatkowych kubitów pomocniczych. One działają jak czujniki: na chwilę „stykają się” z kubitami przechowującymi informację logiczną, a potem są mierzone. Dzięki temu mierzysz czujnik, a nie bezpośrednio dane.

Krok 3: Runda po rundzie — bo błędy nie zdarzają się raz

Korekcja błędów nie jest jednorazowym zabiegiem. To proces ciągły, wykonywany w rundach: przygotuj czujniki, zbierz syndrom, zinterpretuj go, zaktualizuj „stan wiedzy” o błędach, powtórz. Dlaczego to takie ważne? Bo nawet jeśli w danej chwili wszystko wygląda dobrze, za moment może pojawić się kolejne zakłócenie.

Co więcej, pojedynczy odczyt syndromu bywa mylący, bo same pomiary też mogą być niedoskonałe. Dlatego system patrzy na sekwencję wyników z wielu rund, a nie na jeden „snapshot”. To trochę jak weryfikacja po śladach: jedna obserwacja może być przypadkiem, ale seria zgodnych wskazówek zaczyna układać się w wiarygodny obraz.

Krok 4: Dekoder, czyli klasyczny mózg, który zgaduje, co się stało

Dekoder to algorytm działający na klasycznym komputerze, który bierze wyniki pomiarów syndromu i odpowiada na pytanie: jaki scenariusz błędów najlepiej tłumaczy to, co widzimy? To ważne sformułowanie, bo w świecie szumu rzadko masz stuprocentową pewność. Masz natomiast coś, co przypomina mapę poszlak.

Dekoder analizuje te poszlaki i wybiera najbardziej prawdopodobną interpretację. Potem system albo wykonuje poprawkę fizycznie, albo — co często bywa praktyczniejsze — zapisuje ją jako „poprawkę w ramce”, czyli informację, że od teraz pewne rzeczy trzeba interpretować odwrotnie, dopóki nie zostanie to skompensowane kolejnymi operacjami.

Krok 5: Poprawianie bez „naprawiania na siłę”

W intuicji klasycznej naprawa to fizyczna akcja: zmień 0 na 1. W korekcji błędów kwantowych często chodzi o coś subtelniejszego: o to, by utrzymać spójność obliczeń, nawet jeśli na poziomie fizycznym pojawiają się drobne odchylenia.

Dlatego w praktycznych architekturach dużo dzieje się „w interpretacji” stanu logicznego. System prowadzi księgowość błędów: co podejrzewamy, że zaszło, i jak to uwzględniać w kolejnych krokach obliczeń. To brzmi mało spektakularnie, ale jest jednym z powodów, dla których korekcja błędów to jednocześnie inżynieria, informatyka i fizyka w jednym.

Prosty przykład intuicyjny: kod powierzchniowy jako siatka czujników

Jednym z najczęściej omawianych podejść jest tak zwany surface code, czyli kod powierzchniowy. Bez wchodzenia w formalizmy: wyobraź sobie siatkę kubitów ułożonych jak kratka. Część z nich „trzyma” informację, a część pełni rolę czujników, które regularnie sprawdzają lokalną spójność w tej siatce.

Jeśli gdzieś pojawi się zakłócenie, siatka czujników zaczyna dawać charakterystyczne sygnały. Sam sygnał nie mówi „tu jest wynik obliczeń”, tylko „w tej okolicy coś się rozjechało”. A ponieważ czujniki działają w wielu rundach, dekoder potrafi odróżniać pojedynczy fałszywy alarm od stabilnego wzorca błędu.

To podejście ma ważną zaletę: jest lokalne i pasuje do tego, jak realnie buduje się procesory (łatwiej łączyć sąsiadów niż robić połączenia „na skróty” przez cały chip). Ma też koszt: żeby jeden kubit logiczny był naprawdę solidny, potrzeba sporo kubitów fizycznych oraz bardzo stabilnego, szybkiego procesu pomiar–dekodowanie–aktualizacja.

Co korekcja błędów daje w praktyce — i dlaczego to wciąż takie trudne?

Korekcja błędów ma jeden wielki cel: doprowadzić do sytuacji, w której można wykonywać długie obliczenia bez „rozpadania się” wyniku po drodze. To właśnie otwiera drogę do algorytmów, które wymagają wielu kroków i wysokiej precyzji.

Równocześnie to najdroższa część marzenia o użytecznych komputerach kwantowych. Koszt jest podwójny. Po pierwsze, potrzebujesz wielu kubitów fizycznych na jeden logiczny. Po drugie, potrzebujesz bardzo dobrej jakości operacji: jeśli elementy są zbyt hałaśliwe, to system naprawczy będzie generował problemy szybciej, niż je rozwiązuje.

W branży często mówi się o istnieniu progu jakości: powyżej pewnego poziomu niezawodności da się budować coraz lepsze kubity logiczne przez dokładanie kolejnych warstw kodu. Poniżej tego progu dokładanie „zabezpieczeń” nie pomaga, bo zabezpieczenia same wprowadzają za dużo szumu. To nie jest magiczna granica, raczej praktyczny punkt, w którym inżynieria zaczyna się spinać.

Trzy częste nieporozumienia, które mieszają w głowie

Po pierwsze, korekcja błędów nie oznacza, że komputer kwantowy staje się idealny. Oznacza, że potrafi utrzymać błędy na tyle pod kontrolą, by całość obliczeń miała sens, mimo że pojedyncze elementy są niedoskonałe.

Po drugie, korekcja błędów nie polega na kopiowaniu stanu i głosowaniu większością. W świecie kwantowym trzeba obchodzić się z informacją inaczej: wykrywać symptomy zakłóceń, nie zdradzając treści.

Po trzecie, „mam 1000 kubitów” nie znaczy „mam 1000 kubitów do obliczeń”. W erze przejściowej duża część kubitów może iść na czujniki, kodowanie i utrzymanie stabilności kubitów logicznych. To właśnie dlatego dzisiejsze liczby kubitów nie przekładają się wprost na gotowość do rozwiązywania realnych problemów biznesowych.

Pytania, które zwykle padają na końcu

Czy korekcja błędów spowalnia obliczenia?

Tak, bo dodaje dodatkowe operacje i cykle pomiarowe, ale jest to koszt, który kupuje stabilność. Bez tego kosztu wiele obliczeń nie dojechałoby do końca z sensownym wynikiem.

Czy da się robić użyteczne rzeczy bez pełnej korekcji błędów?

Tak, ale to zwykle oznacza krótsze i bardziej „odporne” zadania, gdzie akceptuje się ograniczoną precyzję. Pełna korekcja błędów jest kluczowa, gdy chcesz skalować długość i złożoność obliczeń.

Skąd wiadomo, że dekoder wybiera dobrą poprawkę, skoro to tylko „najbardziej prawdopodobne”?

Nie ma stuprocentowej gwarancji w każdej rundzie, ale siłą podejścia jest statystyka i powtarzalność. Jeśli jakość sprzętu jest wystarczająco dobra, to prawdopodobne scenariusze błędów da się odróżniać na tyle skutecznie, że błąd logiczny staje się coraz rzadszy.