W tym artykule przeprowadzę Cię przez realny obraz: dziś większość zastosowań jest hybrydowa — klasyczny komputer robi dużą część pracy, a komputer kwantowy dostaje mały, dobrze dobrany fragment. Zobacz, jak to działa, jakie są główne strategie i gdzie zwykle pojawiają się ograniczenia.

Dlaczego „hybryda” to domyślny model w quantum computing?

Bo obecne urządzenia kwantowe są jeszcze zbyt delikatne, by samodzielnie „przeżuć” duże, brudne zbiory danych. Mają ograniczoną liczbę kubitów (zwykle mówimy o dziesiątkach lub setkach w praktycznych warunkach), są podatne na szum i nie potrafią długo utrzymywać stanu kwantowego. W efekcie, zamiast wrzucać cały problem do kwantowego pudełka, buduje się pipeline: klasyczny komputer przygotowuje dane i steruje eksperymentem, a część obliczeń deleguje do układu kwantowego.

To podejście nie jest „półśrodkiem”. Jest uczciwą odpowiedzią na to, jak wygląda technologia tu i teraz. I jednocześnie jest najlepszym sposobem, żeby uczyć się quantum bez wchodzenia w fizykę czy matematykę.

Najprostszy obraz przepływu: co robi klasyka, a co kwant?

W typowym scenariuszu dane i decyzje „krążą” między dwoma światami. Klasyczny komputer jest jak reżyser: ma dostęp do pamięci, szybko liczy, wygodnie przechowuje dane i odpala kolejne iteracje. Część kwantowa pełni rolę specjalistycznego akceleratora: wykonuje konkretną operację, której niektóre algorytmy klasyczne nie potrafią łatwo podrobić.

Klasyczny komputer zwykle odpowiada za przygotowanie danych

To obejmuje oczyszczanie danych, usuwanie braków, normalizację i — co bardzo ważne — redukcję wymiaru. W praktyce, zanim dane trafią do obwodu kwantowego, często są „skompresowane” do kilkunastu–kilkudziesięciu cech, bo tyle da się sensownie zakodować przy ograniczonej liczbie kubitów.

Komputer kwantowy wykonuje krótki, powtarzany fragment obliczeń

Najczęściej jest to uruchomienie obwodu kwantowego wiele razy i zebranie wyników pomiaru. Taki wynik to nie gotowa odpowiedź „tak/nie”, tylko próbki, z których klasyczny komputer wyciąga statystyki.

Klasyka domyka całość: optymalizacja i interpretacja

Po stronie klasycznej zwykle działa algorytm, który na podstawie wyników z kwantowego „akceleratora” poprawia kolejne ustawienia (np. parametrów obwodu) i sprawdza, czy wynik się poprawia. Na końcu to klasyczny komputer tłumaczy rezultat na coś, co ma sens w realnym świecie: ranking opcji, etykiety klas, przybliżone minimum kosztu, rekomendację kolejnego kroku.

Kluczowy most: jak zakodować dane klasyczne do kubitów?

Żeby komputer kwantowy mógł pracować na danych z pliku CSV, trzeba je zamienić na stan kwantowy. To moment, w którym wiele osób spodziewa się magii, a spotyka prozę: kodowanie danych bywa trudne, kosztowne i często decyduje o tym, czy całość w ogóle ma sens.

Kodowanie „po cechach” (kąty/bramki) — najbardziej praktyczne na dziś

W tym podejściu liczby z danych (cechy) zamienia się na parametry bramek w obwodzie, na przykład na kąty obrotu. Brzmi skromnie, ale ma duży plus: da się to wdrożyć na dzisiejszym sprzęcie i łatwo kontrolować z klasycznego optymalizatora. Minusem jest to, że przy wielu cechach obwód szybko puchnie, a szum zjada przewagę.

Kodowanie „bitowe” (bazowe) — intuicyjne, ale kubitożerne

Tu myślisz o kubitach trochę jak o bitach: wartość jest opisana przez układ 0/1. Jest to łatwe do wyobrażenia, ale szybko pojawia się problem skali. Jeżeli chcesz opisać wiele liczb z sensowną precyzją, liczba kubitów rośnie, a wraz z nią trudność utrzymania jakości obliczeń.

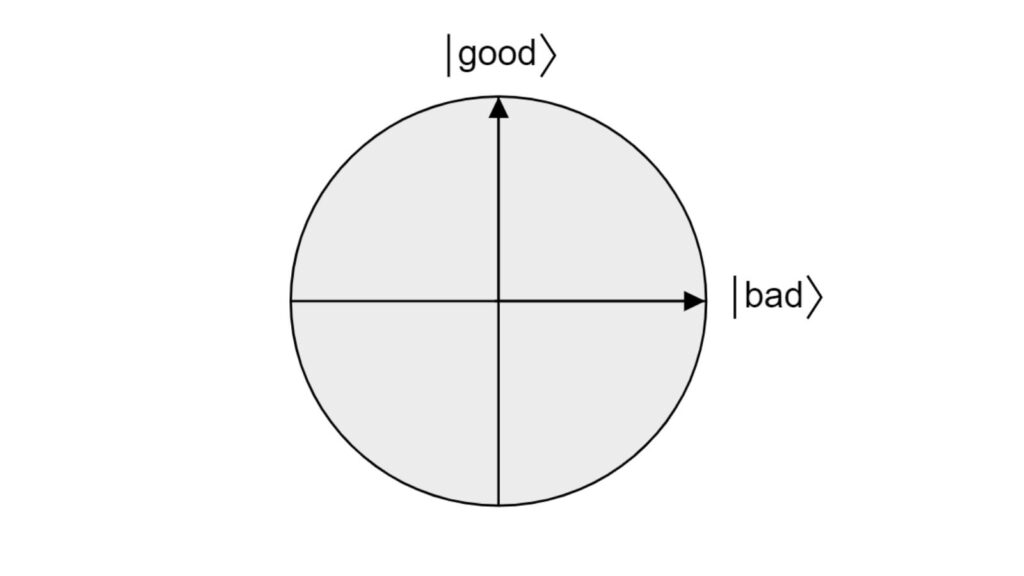

Kodowanie amplitudowe — eleganckie, ale wymagające

W wersji „idealnej” da się upakować dużo informacji w amplitudach stanu kwantowego, czyli w tym, co opisuje superpozycję. W teorii wygląda to pięknie, ale w praktyce przygotowanie takiego stanu bywa kosztowne (w sensie liczby operacji w obwodzie), co na dzisiejszym sprzęcie jest często wąskim gardłem.

Jeśli masz zapamiętać jedną rzecz: „komputer kwantowy przetwarza dane” zwykle oznacza „przetwarza dane, które dało się sprytnie zakodować i ograniczyć”. To nie wada podejścia hybrydowego — to jego sedno.

Najpopularniejsze sposoby łączenia klasyki z kwantem w praktyce

1) Algorytmy wariacyjne: klasyczny optymalizator + kwantowy obwód

To dziś najczęściej spotykany wzorzec. Masz obwód kwantowy z parametrami (pokrętłami). Komputer kwantowy uruchamia obwód i zwraca wynik pomiaru. Komputer klasyczny mówi: „OK, to teraz przekręćmy pokrętła i spróbujmy jeszcze raz”. Ten cykl potrafi powtórzyć się setki lub tysiące razy, aż znajdzie się ustawienie dające najlepszy wynik.

W tej rodzinie mieszczą się m.in. podejścia używane w optymalizacji i w symulacji pewnych problemów chemii/materiałów. Ważne jest to, że kwant robi krótki, powtarzalny fragment, a ciężar „szukania” ustawień spoczywa na klasyce.

2) Quantum jako „generator cech” (feature mapping) do uczenia maszynowego

Jeżeli masz model ML, to często problemem nie jest sama nauka, tylko to, jak przedstawić dane, żeby były rozdzielalne i „łatwe” dla modelu. Tutaj pojawia się idea: obwód kwantowy może zamienić dane wejściowe w nową reprezentację (cechy), a klasyczny model robi resztę.

W praktyce wygląda to tak, że klasyczny pipeline przygotowuje dane (np. standaryzuje), następnie obwód kwantowy koduje próbkę i zwraca statystykę pomiarów, a klasyczny klasyfikator uczy się już na tych wynikach. To nie jest gwarancja przewagi, ale to uczciwy sposób na testowanie, czy kwantowa reprezentacja wnosi coś nowego.

3) Quantum jako podproblem optymalizacyjny (np. w planowaniu i doborze)

W wielu realnych zadaniach biznesowych największy ból jest prosty do opisania: „jest za dużo kombinacji”. Harmonogramy, trasy, przydziały, selekcja podzbioru. Hybryda polega na tym, że klasyczny system układa problem, upraszcza go, narzuca ograniczenia, a kwantowy fragment próbuje znaleźć dobrą konfigurację w gęstym lesie możliwości.

To podejście jest szczególnie naturalne, bo pozwala trzymać dane w klasycznym świecie (tam, gdzie jest to wygodne), a do kwantu przekazywać tylko „esencję” problemu: zmienne decyzyjne i funkcję celu w uproszczonej postaci.

4) Post-processing: kwant liczy, klasyka „wygładza” i sprawdza sens

Nawet kiedy komputer kwantowy zwróci obiecujący wynik, często wymaga on klasycznej obróbki. Powód jest prozaiczny: pomiary są probabilistyczne, a sprzęt szumi. Dlatego klasyka robi potem rzeczy typu uśrednianie, wybór najlepszych próbek, walidację ograniczeń, czasem „naprawę” rozwiązania, żeby spełniało reguły biznesowe.

To może brzmieć jak cofanie się o krok, ale w praktyce jest to różnica między demonstracją w laboratorium a wynikiem, który ktoś może bez stresu wykorzystać.

Przykład bez fizyki: jak wygląda hybrydowy pipeline krok po kroku?

Wyobraź sobie zadanie: chcesz wybrać zestaw elementów do koszyka tak, by zbalansować korzyść i koszt, przy kilku ograniczeniach (np. liczba pozycji, kompatybilność). To archetyp problemu, który klasycznie potrafi rosnąć w trudność, gdy kombinacji jest bardzo dużo.

W hybrydzie często dzieje się to tak:

- Klasyczny komputer przygotowuje dane: filtruje kandydatów, usuwa oczywiste duplikaty, upraszcza ograniczenia i zostawia tylko najważniejsze zmienne.

- Następnie buduje „mały model” problemu, który da się opisać kilkunastoma lub kilkudziesięcioma zmiennymi decyzyjnymi.

- Ten model trafia do kwantowego kroku, który generuje propozycje rozwiązań (w praktyce: wiele próbek), a klasyka wybiera najlepsze.

- Na końcu klasyczny system sprawdza ograniczenia „w realnym świecie”, domyka szczegóły i potrafi rozwinąć rozwiązanie z małego modelu do pełnego (np. uzupełnia brakujące pozycje regułami heurystycznymi).

Zauważ, co jest tu ważne: komputer kwantowy nie musi „zjadać” całej bazy danych. On dotyka tylko tej części, która została przygotowana tak, by mieściła się w jego możliwościach.

Gdzie najczęściej psuje się intuicja (i jak myśleć o tym trzeźwo)?

„Mamy dużo danych, więc kwant pomoże” — niekoniecznie

Duże zbiory danych brzmią jak idealny materiał na „supermoc” komputera kwantowego, ale dzisiaj to często problem, bo samo kodowanie danych do stanów kwantowych może zjeść cały budżet złożoności. W wielu przypadkach lepsza jest strategia: najpierw klasycznie skondensować dane do mniejszej reprezentacji, a dopiero potem testować kwantowy krok.

„Kwant da jedną odpowiedź” — częściej daje rozkład odpowiedzi

Pomiary kwantowe są probabilistyczne. Dostajesz próbki, często z domieszką błędów. Dlatego hybryda jest naturalna: klasyka umie z tego zrobić stabilny wynik, porównać warianty i ocenić, czy rezultat jest sensowny.

„Wystarczy podpiąć API” — integracja to część pracy

Nawet jeśli kwantowy krok działa w chmurze, w praktyce liczy się cały system: przygotowanie danych, wersjonowanie, kontrola jakości, powtarzalność eksperymentów, koszty uruchomień, a także mierzenie tego, czy hybryda naprawdę daje przewagę nad dobrze napisanym rozwiązaniem klasycznym. To nie jest wada — to normalne, kiedy powstaje nowa klasa narzędzi.

Kiedy łączenie danych klasycznych z kwantem ma najwięcej sensu?

Najbardziej sensowne są scenariusze, w których możesz spełnić przynajmniej dwa warunki naraz. Po pierwsze, problem da się ściąć do formy, którą da się wcisnąć w ograniczenia sprzętowe (liczba kubitów, głębokość obwodu). Po drugie, istnieje konkretne miejsce w pipeline, pamiętające o realiach: „tu kwant może być akceleratorem”.

Praktycznie często oznacza to: optymalizację z ograniczeniami, wybór kombinacji, prototypowanie nowych reprezentacji cech w ML albo eksperymenty tam, gdzie klasyczne metody są już bardzo napięte kosztowo.

FAQ: szybkie odpowiedzi na najczęstsze pytania

Czy da się wrzucić do komputera kwantowego cały plik CSV i „niech policzy”?

W praktyce dziś zwykle nie, bo największym wyzwaniem bywa samo zakodowanie dużej ilości danych do ograniczonej liczby kubitów i utrzymanie jakości obliczeń.

Czy to znaczy, że quantum computing to tylko dodatek do klasyki?

Dziś najczęściej tak wygląda praktyka: kwant jest akceleratorem dla wąskiego kroku, a nie zamiennikiem całego systemu obliczeniowego.

Skąd mam wiedzieć, czy mój problem „nadaje się” na hybrydę?

Najczęściej zaczyna się od pytania, czy da się wydzielić mały, powtarzalny podproblem (np. optymalizacyjny lub związany z reprezentacją danych), który można uruchamiać iteracyjnie i mierzyć jakość wyniku.

Co jest trudniejsze: algorytm czy dane?

W wielu projektach trudniejsze okazują się dane: ich przygotowanie, redukcja wymiaru, sposób kodowania do obwodu i stabilne porównanie wyników z baseline’em klasycznym.

Podsumowanie: kwant nie zastępuje danych — uczy je traktować inaczej

Najbardziej trzeźwa perspektywa jest taka: łączenie danych klasycznych z obliczeniami kwantowymi to sztuka budowania dobrego mostu. Klasyka daje skalę, porządek i kontrolę. Kwant wnosi nowe możliwości w wąskim fragmencie, ale wymaga dyscypliny: redukcji, sensownego kodowania i mądrej interpretacji wyników.