Jeśli słyszysz, że „komputery kwantowe są wrażliwe na szum”, to naturalnie pojawia się kolejne pytanie: czy da się te błędy wyłapywać na bieżąco, zanim zepsują wynik? Dobra wiadomość jest taka, że naukowcy potrafią już wykrywać wiele rodzajów błędów podczas działania układu. Trudniejsza część to zrobienie tego wystarczająco szybko i na tyle stabilnie, żeby przejść od demonstracji w laboratorium do niezawodnej „kwantowej produkcji”.

Zobacz, jak to działa: bez matematyki, bez magii i bez obietnic, że „już jutro” wszystko będzie naprawiane automatycznie.

Co w ogóle znaczy „w czasie rzeczywistym” w świecie kwantowym?

W klasycznych komputerach „czas rzeczywisty” kojarzy się z reakcją natychmiastową: system widzi błąd i od razu go poprawia. W komputerach kwantowych to pojęcie jest bardziej praktyczne niż filozoficzne. Najczęściej chodzi o to, czy system potrafi zbierać sygnały o błędach i przetwarzać je na tyle szybko, by nadążyć za kolejnymi krokami obliczeń.

To ważne, bo kubity działają w krótkich oknach czasowych i są podatne na zakłócenia. Jeśli „analiza błędów” trwa zbyt długo, to informacja o nich przychodzi spóźniona — jak alarm przeciwpożarowy, który uruchamia się, kiedy pożar już zgasł (albo spalił pół budynku).

Skąd biorą się błędy kwantowe (w wersji bez straszenia)

Kubity są delikatne, bo ich stan łatwo rozmywa się pod wpływem otoczenia. Do tego dochodzą niedoskonałości sterowania: impulsy, które miały wykonać konkretną operację, czasem robią ją „prawie dobrze”. W efekcie w obliczeniu pojawiają się przekłamania.

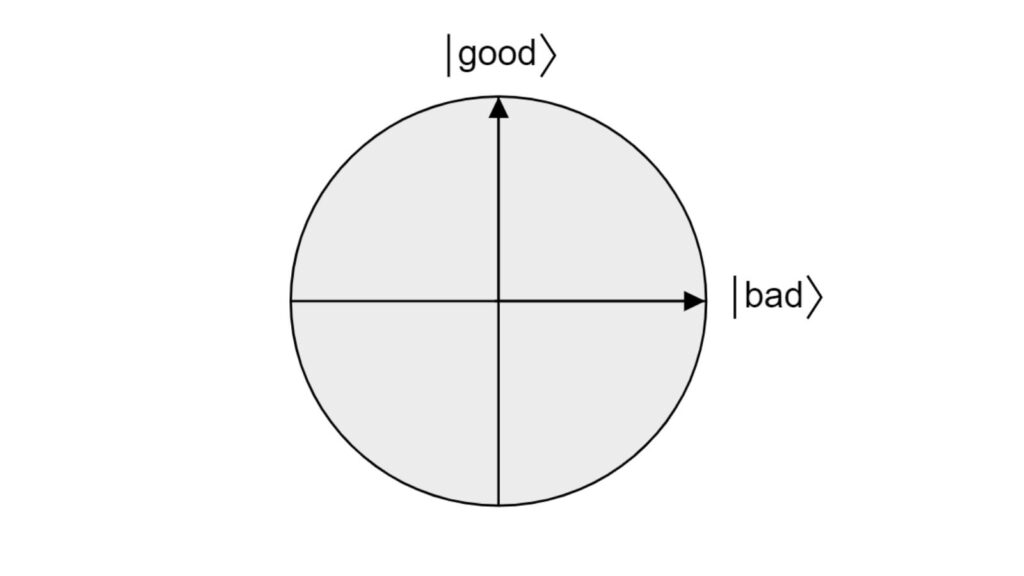

W uproszczeniu mówi się o dwóch „rodzinach” błędów: takich, które odwracają wartość (jak klasyczne 0 ↔ 1), oraz takich, które psują relację fazy (czyli coś typowo kwantowego, co wpływa na interferencję). W realnym sprzęcie te efekty często mieszają się ze sobą, ale to rozróżnienie pomaga zrozumieć, po co w ogóle tworzy się kody korekcji błędów.

Jak wykryć błąd, skoro nie można „zajrzeć” do kubitu?

To sedno sprawy. Gdybyśmy po prostu zmierzyli kubit, żeby sprawdzić, czy „jest OK”, zniszczylibyśmy stan, na którym opiera się obliczenie. Dlatego w praktyce wykrywanie błędów robi się pośrednio.

Najczęstszy pomysł wygląda tak: do właściwych kubitów (tych niosących obliczenie) dodaje się kubity pomocnicze. Te pomocnicze mierzy się w taki sposób, aby nie odczytać „jaki jest wynik obliczenia”, tylko odpowiedzieć na pytanie typu: „czy w tej grupie kubitów zaszła niezgodność, która wygląda jak błąd?”.

Wyniki takich pomiarów tworzą wzór, który nazywa się często syndromem błędu. To nie jest informacja o tym, co dokładnie liczy komputer, tylko sygnał: „tu coś się najpewniej wydarzyło”. I to właśnie da się zbierać cyklicznie — krok po kroku — podczas działania układu.

Detekcja to nie to samo co korekcja. I to jest dobra wiadomość

W pytaniu o „czas rzeczywisty” łatwo założyć, że komputer kwantowy musi natychmiast wykonywać fizyczną poprawkę na kubitach. W praktyce często nie jest to konieczne.

W wielu podejściach wystarczy, że system na bieżąco śledzi, jakie poprawki należałoby zastosować, a następnie uwzględnia je „logicznie” w dalszym przebiegu programu. Taki sposób myślenia bywa opisywany jako prowadzenie czegoś w rodzaju wirtualnej listy poprawek (czasem mówi się o „ramie Pauliego”, ale nie musisz zapamiętywać nazwy). Efekt jest podobny: obliczenie idzie dalej, a informacja o błędach nie ginie.

To podejście ma ogromną zaletę: zmniejsza presję, by każdą korektę wykonywać fizycznie natychmiast. Natomiast nie zwalnia z wymogu „real-time” w innej części układu: trzeba szybko przetwarzać syndromy i nadążać z decyzjami, co one znaczą.

Jak wygląda wykrywanie błędów „na żywo” w praktyce?

Najbardziej znany rodzinny przykład to tzw. surface code, czyli podejście, w którym kubity układa się w strukturę przypominającą siatkę, a pomiary syndromów wykonuje cyklicznie. Nie jest to jedyny kod, ale dobrze pokazuje logikę real-time.

1) Szybkie, powtarzalne pomiary kubitów pomocniczych

Układ wykonuje rundę operacji i pomiarów na kubitach pomocniczych. Ta runda powtarza się wielokrotnie. Kluczowe jest to, że mierzymy „sygnały kontrolne”, a nie stan obliczenia. Z zewnątrz wygląda to trochę jak telemetryka w samolocie: nie zaglądasz do silnika w trakcie lotu, ale stale czytasz czujniki.

2) Dekodowanie, czyli zrozumienie, co oznacza wzór pomiarów

Same pomiary to jeszcze nie odpowiedź. Trzeba je zinterpretować: czy ten wzór bardziej pasuje do jednego błędu, czy do innego? I tu pojawia się klasyczny „mózg” całego procesu: dekoder, czyli algorytm (uruchamiany na klasycznym sprzęcie), który na podstawie kolejnych rund syndromów wnioskuje najbardziej prawdopodobny przebieg błędów.

W realnych systemach to dekodowanie musi działać bardzo szybko, bo inaczej kolejki danych rosną, a korekcja przestaje nadążać za obliczeniem. Dlatego w praktyce dużo mówi się o dekoderach uruchamianych na wyspecjalizowanym sprzęcie, takim jak układy FPGA czy inne przyspieszacze.

3) Decyzja: poprawiamy fizycznie czy „logicznie”?

Na koniec trzeba podjąć decyzję, co zrobić z informacją o błędzie. Czasem sensowniej jest wykonać szybką operację korygującą, a czasem bezpieczniej jest tylko odnotować poprawkę i uwzględnić ją w dalszych krokach programu. To nie jest jedna uniwersalna strategia — zależy od architektury sprzętu i od tego, jak dany system radzi sobie z dodatkowym ruchem sterowania.

Więc… czy da się? Tak, ale w konkretnym znaczeniu

Jeśli przez „wykrywanie błędów kwantowych w czasie rzeczywistym” rozumiesz zbieranie syndromów podczas działania układu i bieżące wnioskowanie, co one oznaczają, odpowiedź brzmi: tak, to jest realny, aktywny obszar technologii i już dziś jest demonstrowany eksperymentalnie.

Jeśli jednak myślisz o pełnej, produkcyjnej korekcji błędów w dużej skali — takiej, która pozwala długo utrzymywać stabilny „kubitu logiczny” i uruchamiać długie algorytmy bez rozsypywania się wyniku — to wchodzimy w etap, który nadal wymaga ogromnej liczby kubitów fizycznych, bardzo dobrej jakości operacji oraz szybkiego, niezawodnego sterowania.

Warto też pamiętać o czymś przyziemnym: „czas rzeczywisty” to nie tylko fizyka, ale i inżynieria całego łańcucha. Liczy się elektronika pomiarowa, opóźnienia przesyłu danych, stabilność kalibracji, a nawet to, jak często system trzeba „stroić”, żeby nie odpływał od optymalnych parametrów.

Co jest dziś największą przeszkodą w prawdziwym real-time?

Najczęściej ograniczeniem nie jest sam pomysł, tylko tempo i jakość wykonania.

Po pierwsze, pomiary muszą być szybkie i wiarygodne, bo jeśli czujnik myli się częściej niż błędy, które próbujesz wyłapać, sytuacja robi się paradoksalna: system „koryguje” coś, co nie było problemem.

Po drugie, dekoder musi działać w rytmie układu. W małej skali da się to zrobić „z zapasem”. W większej skali interpretacja syndromów staje się bardziej wymagająca, a architektura sterowania musi być projektowana niemal tak samo starannie jak sam procesor kwantowy.

Po trzecie, dochodzi kwestia ubocznych efektów: każdy dodatkowy pomiar i każda dodatkowa operacja to ryzyko, że wprowadzisz nowy szum. Dlatego nowoczesne podejścia często balansują między częstotliwością pomiarów, strategią dekodowania i tym, czy korekcję robić fizycznie, czy „na kartce”.

FAQ: krótkie odpowiedzi na najczęstsze wątpliwości

Czy wykrywanie błędów nie niszczy obliczenia?

Nie musi, bo mierzy się kubity pomocnicze i odpowiednio dobrane własności układu, a nie bezpośrednio „wynik” na kubitach obliczeniowych.

Czy komputer kwantowy sam wie, że się pomylił?

W pewnym sensie tak: z rund pomiarów powstaje syndrom, który sygnalizuje, że zaszło zdarzenie pasujące do błędu, ale interpretacja wymaga klasycznego dekodera.

Czy real-time oznacza, że błędy są poprawiane natychmiast?

Niekoniecznie. Często wystarczy śledzić poprawki i uwzględniać je logicznie w kolejnych krokach, bez natychmiastowej fizycznej ingerencji.

Czy to znaczy, że „problem szumu” jest już rozwiązany?

Jeszcze nie. Detekcja i częściowa korekcja są możliwe, ale pełna niezawodność w dużej skali to nadal intensywna praca inżynieryjna i naukowa.